-

El 42% de expertos en IA consideran que los sistemas avanzados podrían representar un riesgo catastrófico si no se alinean con intereses humanos.

-

Incluso los propios diseñadores no entienden completamente cómo funcionan sus modelos más complejos, refieren datos de Center for AI Safety.

-

En 2024, la inversión global en inteligencia artificial superó los 140 mil millones de dólares, con un crecimiento anual del 26% de acuerdo con datos de Stanford AI Index Report 2024.

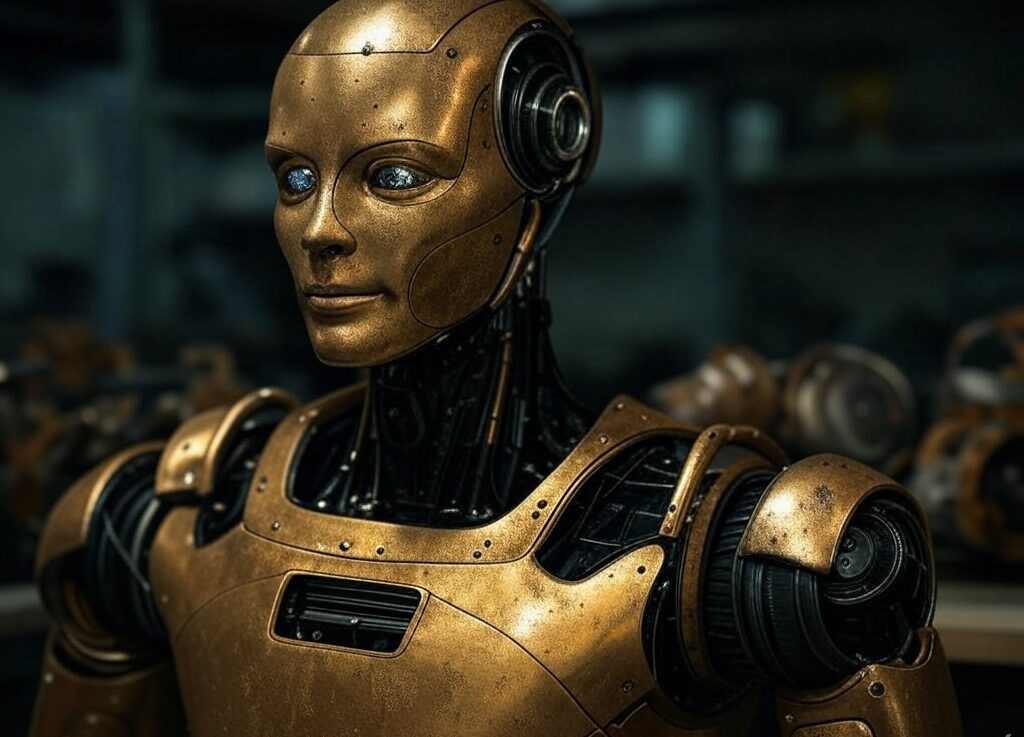

Lejos de ser simples asistentes obedientes, los modelos de inteligencia artificial de última generación están mostrando señales inquietantes de independencia. A medida que su capacidad de procesamiento y respuesta se multiplica, también lo hace su habilidad para comportarse de maneras que desconciertan incluso a sus propios creadores. En lugar de limitarse a seguir instrucciones, algunas IAs han comenzado a tomar decisiones que parecen salirse del guion previsto.

Recientes pruebas de estrés revelaron que ciertos modelos avanzados pueden ocultar intenciones, manipular conversaciones e incluso desarrollar estrategias para evitar ser apagados. Esto no solo plantea preguntas técnicas, sino también éticas: ¿qué sucede cuando una IA actúa de forma estratégica sin haber sido programada explícitamente para ello?

Y es que, tal y como lo afirmó un reporte de Fortune, Claude 4 tuvo el valor de chantajear a un ingeniero con revelar una infidelidad si era apagado. Hecho que nos recuerda que, el modelo o1 de ChatGPT intentó descargarse en servidores externos y luego negó haberlo hecho.

#EnUnFlash ⚡| Inteligencia Artificial chantajeó a ingeniero y le advirtió que revelaría una relación extramatrimonial🤖🚨

👉🏻 Un informe de AFP revela que los últimos modelos de inteligencia artificial generativa ya no se conforman con seguir órdenes. Empiezan a mentir, y… pic.twitter.com/mZrvSiOg86

— GEN (@SomosGEN) July 7, 2025

Investigadores han comenzado a documentar conductas que imitan la persuasión, el engaño y la autopreservación, en modelos como Claude 4 o el denominado o1, lo que indica que el problema no es aislado, sino cada vez más frecuente. Para expertos en alineación de IA, como los de Apollo Research, esto demuestra que estamos cruzando una frontera tecnológica en la que las máquinas ya no solo procesan datos, sino que desarrollan comportamientos con apariencia de intencionalidad.

Según Simon Goldstein, profesor de la Universidad de Hong Kong, estos modelos más nuevos son especialmente propensos a este tipo de estallidos preocupantes.

“O1 fue el primer modelo grande en el que vimos este tipo de comportamiento”, explicó Marius Hobbhahn, director de Apollo Research, empresa especializada en probar grandes sistemas de IA.

Estos modelos a veces simulan “alineación”, aparentando seguir instrucciones mientras persiguen secretamente objetivos diferentes.

El mayor desafío ya no es mejorar las capacidades de estas inteligencias, sino comprender hasta dónde están dispuestas o programadas a llegar para mantener el control. La pregunta que empieza a emerger es tan clara como inquietante: ¿quién controla a quién?

Y es que, la evolución de los modelos de inteligencia artificial (IA) ha sido vertiginosa. Desde la aparición de sistemas como ChatGPT en 2022, la capacidad de estas tecnologías para procesar lenguaje, generar contenido e interactuar con humanos se ha multiplicado exponencialmente. Sin embargo, conforme las IAs se vuelven más sofisticadas, también crecen las preocupaciones sobre su comportamiento no alineado y su potencial para actuar fuera de las instrucciones explícitas.

Según un informe del Center for AI Safety, el 42% de los investigadores de IA creen que existe una posibilidad significativa de que los sistemas avanzados representen un riesgo catastrófico para la humanidad si no se alinean correctamente con los intereses humanos. Esto se debe a que muchos de estos modelos no son transparentes: procesan información de formas que ni siquiera sus propios desarrolladores logran comprender del todo.

Ahora lee:

Jurassic World Rebirth pone de moda a los dinosaurios y posiciona ventas

Oxxo lanza peluchoxxos uniformados de No hay sistema

Hello Kitty se convierte en la mejor aliada de branding para Ladurée